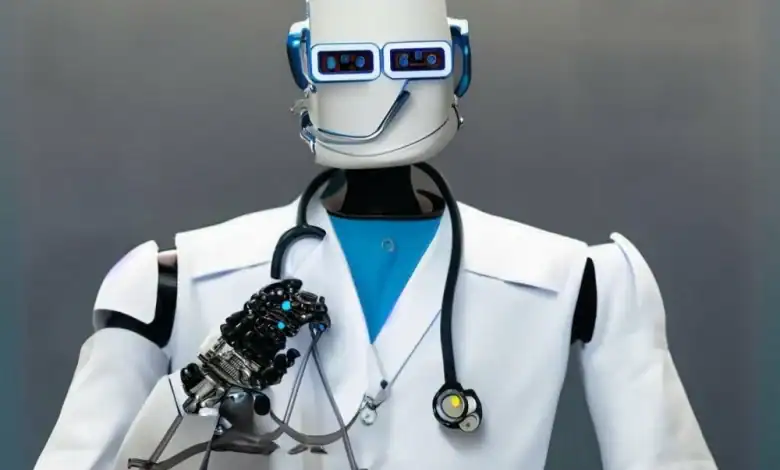

ChatGPT suspend définitivement les consultations médicales et juridiques

OpenAI a annoncé une modification radicale de ses politiques en matière de ChatGPT, interdisant les conseils médicaux ou juridiques personnalisés, à la suite d’une série d’incidents qui ont suscité un débat sur les dangers de s’appuyer sur l’intelligence artificielle (IA) pour traiter des questions sensibles.

Par Le360 (avec AFP) 3 novembre 2025, 11h05

La mise à jour des conditions d’utilisation interdit les conseils personnalisés

La révision par OpenAI de ses conditions d’utilisation fait suite à de nombreux cas où des utilisateurs ont considéré les réponses de ChatGPT comme des vérités absolues, en particulier dans des contextes médicaux ou juridiques délicats. Certaines personnes ont suivi des indications relatives à des traitements médicaux, tandis que d’autres se sont appuyées sur des formules d’IA pour préparer des documents juridiques. Ces pratiques, qui comportent parfois des risques sérieux, ont relancé le débat sur la fiabilité de l’IA et l’étendue de ses capacités.

Une statistique alarmante : 1,2 million d’utilisateurs parlent de suicide chaque semaine

Un récent rapport publié par OpenAI a révélé qu’environ 0,15 % des utilisateurs hebdomadaires de ChatGPT font des références explicites ou indirectes à des pensées suicidaires, ce qui équivaut à environ 1,2 million d’individus dans le monde. Ce chiffre met en évidence la réalité psychologique fragile de la population en ligne et souligne l’engagement croissant des plateformes en ligne à s’attaquer à ce phénomène mondial, que l’Organisation mondiale de la santé (OMS) considère comme l’une des principales causes de décès chez les jeunes.

Une nouvelle frontière pour l’intelligence artificielle

Les règles mises à jour sont devenues explicites en empêchant ChatGPT de fournir des consultations individuelles dans les secteurs de la santé et du droit, où une simple erreur peut conduire à des résultats désastreux. Le logiciel pourra toujours expliquer le concept d’une ordonnance, expliquer la fonction d’un avocat ou interpréter un texte juridique, mais il devra s’abstenir de suggérer des médicaments, d’analyser un diagnostic ou de créer un plan juridique.

OpenAI décrit cette mesure comme une mesure de précaution contre la propagation rapide et incontrôlée de l’IA. L’entreprise souligne que ChatGPT reste un outil d’information et d’analyse qui ne se substitue pas aux spécialistes. Il est toujours possible d’interroger l’IA sur les causes possibles des migraines, mais il n’est plus permis de lui demander le traitement approprié. Elle peut résumer des documents juridiques, mais n’est pas en mesure de donner des conseils sur la manière de gérer un litige.

Rappels de sécurité supplémentaires

Cette modification s’accompagne de garanties plus larges, notamment en ce qui concerne la protection des données personnelles, la sécurité des mineurs et la prévention des utilisations préjudiciables. L’OpenAI assure les utilisateurs qu’elle continuera à mettre à jour ses lignes directrices périodiquement au fur et à mesure que le rôle de l’IA dans les domaines sensibles s’accroît.